単純な解決策が複雑な現実と出会うとき

私たちは、最も差し迫った課題が複数の複雑なシステムの交差点から生まれる時代に生きています。そこでは、技術革新が社会変化と交わり、経済的圧力が環境的制約と絡み合い、地域での意思決定がグローバルな影響を引き起こすこともあります。これらの多面的な問題は、要素を切り分けて個別に扱うような還元主義的アプローチでは対処が困難です。なぜなら、最も重要な特性は構成要素自体からではなく、構成要素間の相互作用から生まれるからです。

現在の人工知能の状況を考えると、ほとんどのAIイノベーションは、画像認識、音声処理、翻訳といった明確に定義されたタスクで発生していることは注目に値します。これらは明確なパラメータと測定可能な結果を持つ領域です。しかし、人類がこれまで遭遇したことのない状況や、予測不可能な方法で相互作用する複数の複雑なシステムを含むタスクについてはどうでしょうか?サイバー戦争を含む国防シナリオのシミュレーション、生態系全体での連鎖的環境影響の予測、生物学的、社会的、経済的要因が絡み合うグローバルなパンデミック対応について考えてみましょう。

私たちは、学問分野の枠を超えて考え、現実に存在する複雑さをありのままに捉え、受け入れるための新たなアプローチを模索する必要があります。現代社会は、物事を管理しやすくするために全てを単純化するよう設計されていますが、私たちが理解しようとしているものが複雑なシステム間の相互作用から生まれる予測不可能な創発である場合、このアプローチでは限界があることが明らかになりつつあります。

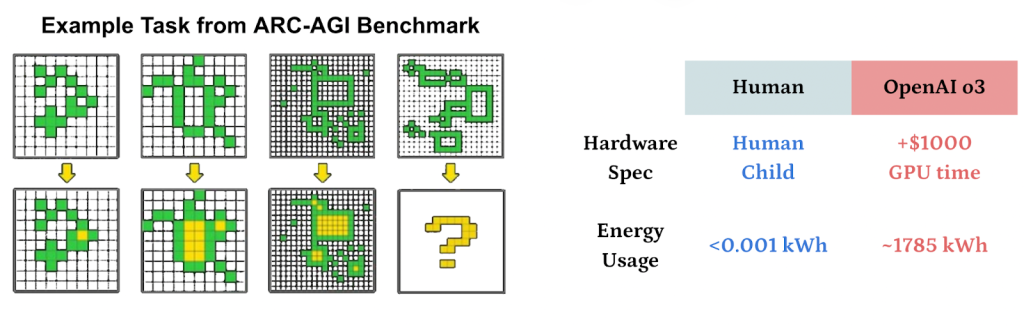

最初の3つの例から学び、不足している部分を完成させましょう。子どもには簡単なことでも、AIにとっては持続不可能なほどコストが高くなるのはなぜでしょうか?

現在のAI、すなわち実質的に大規模言語モデル(LLM)と同義の技術は、予測不可能なシナリオにおいて根本的な限界に直面しています。これらのシステムは、学習データ内で既に観察されたパターンに基づいてのみ推論を行うため、真に新しい状況や、明示的にモデル化されていない複雑なシステム間の相互作用に直面すると、有意義な洞察を導き出すことが困難になります。その結果、もっともらしく聞こえるが本質的には不十分な回答を、表層的なパターンマッチングに基づいて提示してしまうのです。

「私たちには、複雑さを単純化するのではなく、ありのままに受け入れるシステム設計を構想する手助けができるAIが求められています。そうしたAIは、不確実な状況の中で自然のシステムが適応し、繁栄してきた適応的プロセスから着想を得るべきです。」

AIが進化を続ける中で、私たちはその限界を超え、真に未知の領域に踏み出すことのできるシステムを必要としています。単に既存のパターンを高度に再構成するだけでなく、新たなアイデアを生み出し、未知の分野を探求し、革新的な解決策を創出できるAIが求められています。私たちには、複雑性を減らすのではなく受け入れるシステム設計を想像するのに役立つAIが必要であり、自然システムが不確実性の中で繁栄することを可能にする適応プロセスからインスピレーションを得る必要があります。

しかし現在のAI開発は、計算リソースとデータ量の拡大によって性能向上を図るエンジニアリング主導の戦略に大きく依存しています。「スケーリング戦略」として、大規模なモデルに膨大なデータを投入する手法が一般的になり、一種の計算軍拡競争につながり、真に知的で適応的なシステムを創造するというAIの本来の約束からむしろ遠ざかる可能性がありながら、膨大なリソースを消費しています。

ここで注目されるのが、「オープンエンデッドネス(open-endedness)」という概念です。

異なる前進への道

オープンエンデッドネスは、実は新しい概念ではありません。研究者たちは40年以上にわたり、特に人工生命(ALife)の分野でこの概念を探求してきましたが、近年では従来のAIアプローチが限界に直面する中で、再び注目を集めています。その本質は、AIシステムが明確な目標や指示に従うことなく、未知の問題空間を自律的に探求し、常に新しいアイデアや解決策を生み出し続ける能力にあります。

オープンエンデッドネスの特異性を理解するには、現在主流のLLMと対比してみると分かりやすいでしょう。両者は補完的に機能することもありますが、その根本にある原理は大きく異なります。

数十年間、大規模言語モデル(LLM)を含む従来のAI研究は、単一の原理によって導かれてきました:与えられた目的関数を最適化することです。簡単な例を考えてみましょう:AIに「可能な限り速く走る」ことを課した場合、速度が目的関数になります。システムは自然に、馴染みのある移動パターンを最適化する方向に向かい、おそらく標準的な二足歩行を改良してそれを段階的により速くするでしょう。それが自発的に行わないのは、走ることから転がることへの切り替えや、人間が考えたこともない前例のない移動形態の開発など、まったく新しい移動方法を発明することです。

この限界が、オープンエンデッドネス研究における革新的なブレイクスルーを生み出しました。それが「ノベルティ・サーチ(Novelty Search)」です。ケネス・スタンリー氏らによって開発されたこの手法は、従来の目標志向のアプローチを意図的に捨て去り、「新規性」そのものを主要な評価基準とします。すなわち、表面的なゴールにどれだけ近づいたかにかかわらず、従来とは異なる斬新な解決策に対して報酬を与えることで、予測可能な解に収束するのを防ぎ、より広大で多様な解の空間を探索できるようにしているのです。

型にはまらない思考: 目的関数からの解放

その可能性にもかかわらず、ノベルティ・サーチは当初、AIコミュニティから強い抵抗を受けました。明確な目標への到達よりも「新規性」を優先するという発想は、長年にわたり根付いてきた問題解決のアプローチと根本的に相容れなかったためです。ALife研究所の代表理事である岡瑞起教授にとって、このパラドックスは挫折ではなく、むしろインスピレーションの源となりました。データマイニングおよび機械学習の分野でキャリアをスタートさせた彼女は、既定の目標に対してわずか0.1%の精度向上を目指すという、過度に細分化された研究姿勢に次第に違和感を抱くようになります。彼女は次のように語っています。「特定のベンチマークに対して、精度をほんの少し(たとえば0.1%)向上させるアルゴリズムを考えなければならないことに、本当にフラストレーションを感じていました。目標は他者によって設定され、自分は学生や若手研究者として、それを少しでも良くするアルゴリズムを開発する。それが研究人生の30年間だとしたら、ワクワクしないし、自分には到底続けられないと感じたんです。」

岡瑞起教授が人工生命(ALife)に惹かれたのは、それが従来の機械学習とはまったく異なる、計算やインテリジェンスに対する新たなアプローチを提示していたからです。ALifeは急進的な代替案を提示しました:事前定義された目的なしにシステムを作成し、どのような行動や未来が現れるかを観察することです。「それはより探索的な種類のアプローチです」と彼女は述べています。「何かを作り、それらを実行させ、システムがあなたを興奮させるものや驚かせるものを生み出せば成功です。」現在、ノベルティ・サーチは理論的領域から実用的応用に向けて徐々に移行しています。

興味深いことに、AIにおける最も称賛された成果のひとつである、2016年のAlphaGoによる李世乭(イ・セドル)九段への勝利には、すでにオープンエンデッドネスの側面が実証されていました。中でも有名な「37手目」は、開発者さえも驚かせた斬新な一手であり、人類がこれまで想像しなかった戦略をAIが見出した瞬間でした。AlphaGoは明示的にオープンエンデッドなシステムとして設計されたわけではありませんが、人間の先入観を超えてAIが創造性を発揮した好例といえるでしょう。近年では、SakanaAIのAI ScientistやGoogleのAI Co-Scientistなどのプロジェクトが、ノベルティ・サーチの原理に着想を得た探索駆動型のメカニズムを明示的に採用し、科学的発見において新規性と創造性を重視する取り組みを進めています。さらに、AlphaGoの後継モデルであるAlphaEvolveは、強化学習や進化的手法を従来のLLMソフトウェアスタックと組み合わせることで、明確な目的関数が設定された限定的な領域においても、有望な成果を示すことに成功しました。こうした展開は、特に複雑かつ境界の定まらない領域において真に新しい解決策を見出すには、従来の最適化主義的アプローチよりも、探索重視の姿勢の方が有効である可能性を示唆しています。

インテリジェンスからの移行

オープンエンデッドネスというアプローチが本質的に意義深いのは、それが自然界における革新の原動力、すなわち「進化」と深く結びついているためです。自然界において、生物はあらかじめ定められた目標に向かって最適化されているわけではなく、種の発展を導く普遍的な目的関数も存在しません。むしろ、生物は環境の変化に応じて自由に形質を適応させ、行動を変化させながら、生存のための新たな戦略を発見してきました。こうしたオープンエンドな進化のプロセスこそが、生命の驚くべき多様性を生み出してきたのです。―その多くは、目標に向かって直接的に最適化するという従来のエンジニアリング的思考では到底到達できない、創造的かつ非直線的な問題解決の手段であるといえます。―

自然界の進化は、私たちの想像をはるかに超える多様な生物や機能を次々と生み出してきました。これは「インテリジェンス」だけでは辿り着けない、広大で未踏の創造空間が存在することを示しています。つまり、この進化のプロセスを計算資源によって加速・再現することで、これまでに存在しなかった革新的なアイデアや技術の発見を促す可能性があるのです。

AI研究者たちは、進化の原理を応用するために、さまざまな枠組みを開発してきました。たとえば、進化的アルゴリズムや遺伝的アルゴリズムは、自然選択が新たな解を創出する能力を模倣し、特定の目標に縛られずに多様な解を探索する手法です。さらに高度なアプローチとしては、NEAT(NeuroEvolution of Augmenting Topologies)のように、ニューラルネットワークの重みだけでなく構造そのものを進化させる技術も存在します。また、CPPNs(Compositional Pattern Producing Network)は、複雑な構造を間接的にエンコードする方法を提供し、比較的単純な進化プロセスから高度で洗練されたパターンの生成を可能にします。

「自然界の進化は、私たちの想像をはるかに超える多様な生物や機能を次々と生み出してきました。これは、インテリジェンスのみでは到達し得ない、広大な創造の可能性が存在することを示しています。」

これらの進化に着想を得た技術には共通点があります:搾取よりも探索を、最適化よりも多様性を、漸進的な改良よりも新規性を重視しています。そうすることで、人工知能において真のオープンエンデッドネスを達成するための有望な道筋を提供しています。つまり、継続的に予期しない解決策を生成し、真に未知の領域に冒険することができるシステムです。これは、革新の唯一の源としての知能からの深遠な転換を表しています。

相乗的な関係

オープンエンデッドネスと人工知能は、それぞれ異なる次元に存在しながらも、互いに深く交差し、影響し合う関係にあります。オープンエンデッドネスは、主に哲学的な指針や概念的な目標として機能し(AlphaGoの驚くべき一手に見られるように)、一方で、人工知能はそのビジョンを実現するための実践的なツールや枠組みを提供する役割を担っています。

この関係は双方向に機能します。オープンエンデッドネスはAIを現在の限界を超えて押し進める一方、LLMの進歩は真にオープンエンデッドなシステムを実装する私たちの能力を劇的に加速しています。最も重要な突破口は、「曖昧で主観的な評価基準」を扱うLLMの能力です。これは、最適化すべき明確で定量化可能な目的を必要としていた初期のAIが扱えなかったものです。

OMNI-EPIC研究はこれを見事に実証しています。研究者たちは「興味深さ」を目的関数として設定することで、人間が本当に関心を惹かれるような解を自律的に生成するAIシステムの構築に成功しました。これは従来のアプローチに対する根本的な転換を示しています。というのも、「興味深さ」のような概念は、これまであまりにも主観的かつ抽象的であるがゆえに、効果的な目的関数として扱うことが困難であり、従来のアルゴリズムでは定量化が不可能とされてきたからです。

LLMは、膨大な人間生成コンテンツに触れることで、人間の「興味」や「驚き」、「美的感覚」といった主観的な価値基準を暗黙的に学習してきました。その結果、従来のシステムでは対応できなかった曖昧な評価基準を適切に解釈・適用できるようになっています。これにより、AIは単なる抽象的な新規性を追求するだけでなく、人間が意味や価値を感じる方向へと探索を進めることが可能となり、私たち人間には思いつかないような革新的なアイデアを、理解可能なかたちで生み出すことができるのです。これこそが、真のオープンエンデッドネスの本質です。

LLMは、オープンエンデッドネスにおけるもう一つの大きな課題―すなわち「変異」―に対しても、新たな解決策を提示しています。多くのオープンエンデッドネス・アルゴリズムは進化的プロセスに着想を得ており、既存の解を変異させることで新たな可能性を創出しようとします。従来この変異はランダムな修正によって実装されていましたが、計算効率が低く、意味のあるバリエーションよりも無意味な生成結果が多くなるという課題がありました。

LLMが可能にするのは「スマートな変異(smart mutation)」です。盲目的かつランダムな変更とは異なり、これらのモデルは新規性と意味の両方を備えた変更を文脈に応じて導入することができます。これにより、革新的な解を生み出す確率が飛躍的に高まり、不要な計算リソースの消費も大幅に削減されます。従来のシステムでは、有望なバリエーションをひとつ見つけるのに数千回ものランダムな変更が必要でしたが、LLMは高い成功率で、より的確かつ意味のある変異を実行することができるのです。

オープンエンデッドネスの哲学とLLMの能力が融合することで、私たちを継続的に驚かせるAIシステムの可能性が開かれつつあります。ここで言う「驚き」とは、単なるランダムな新奇性ではなく、私たちの「可能性に対する理解」を拡張するような、真に独創的な解をもたらすことを意味します。

応用と今後の展望

オープンエンデッドネスの潜在的な応用は、既存のAIシステム(たとえばLLM)が限界を露呈している領域において、特に魅力的です。複数の複雑なシステムが相互に作用する社会システムや安全保障シナリオは、まさにその代表例です。たとえば、前例のない地政学的課題に対応するための国家防衛シナリオのシミュレーションや、社会運動がデジタル空間と物理空間を横断しながらどのように展開していくかをモデル化する、といった応用が考えられます。

こうした複雑な政策応用にとどまらず、オープンエンデッドネスは、より身近な分野にも変革をもたらす可能性を秘めています。たとえば、ゲームやエンターテインメントの分野では、武器やキャラクター、さらには世界そのものを自動生成するシステムが登場し、プレイヤーが既視感のあるテーマの変奏ではなく、真に予測不能なシナリオと出会える「オープンエンデッド」な体験が実現するかもしれません。教育分野においても同様の可能性があります。現在のAIは、子どもの無限の創造性には到底及びませんが、オープンエンデッドなシステムであれば、学習者一人ひとりに応じてリアルタイムに適応・進化し、新たな課題や説明を生成することで、個別最適化された学びの旅を提供できるかもしれません。

おそらく最も大きな期待が寄せられるのは、単なる実験の自動化を超えた、医療や科学研究への応用です。オープンエンデッドなAIシステムは、これまで存在しなかった仮説を創出したり、予期しない研究の方向性を提示したり、人間の研究者が見落としていたパターンや可能性を発見したりすることで、誰も到達していない真の意味での科学的ブレイクスルーに貢献する可能性があります。

「オープンエンデッドネスは、インテリジェンスを狭く人間中心的に定義する枠組みを超えた理解を促すことで、AIの社会的役割に関する公共的な議論を一層深める可能性を秘めています。」

もちろん、新規性そのものが有益性を保証するわけではなく、オープンエンデッドネスには重要な倫理的課題が伴います。最大の課題は、AIの創造性を人間にとって理解可能で、かつ価値あるものとして維持することにあります。求められるのは、自律的かつ創造的でありながら、人間の価値観や理解と本質的に整合するシステムです。そのようなシステムを実現するには、人間の主体性を損なうことなく、有意義な解の探究を促進するためのフィードバック機構や評価基準の設計について、慎重かつ綿密な検討が必要です。

今後を見据えると、オープンエンデッドネスは、インテリジェンスの理解を狭義の人間中心的な定義から拡張することによって、AIの社会における役割に関する公共の議論を豊かにする可能性を秘めています。AIの発展を「人間の脅威か、あるいは従順な道具か」といった二項対立で捉えるのではなく、異なるかたちの知能が共存し、相互に補完し合うような、より複雑で洗練された関係性を提示します。こうした視点は、テクノロジーの可能性に関する議論を単純化された物語から解放し、より深く本質的な理解へと導く手がかりとなるでしょう。

多元的なAIの未来に向けて

オープンエンデッドシステムは、より伝統的な最適化重視のアプローチ、強化学習システム、記号的推論フレームワークと並んで動作し、探索と新規性生成に対する独自の能力に貢献するでしょう。この多元的アプローチは、知能自体が多面的であることを認めています。時には精密な計算が必要であり、時には創造的な飛躍が、そしてしばしば探索と活用の間の動的な相互作用が必要です。オープンエンデッドネスをこのより広いAIエコシステムの一つの本質的な構成要素として受け入れることで、私たちはより回復力があり、より創造的で、ますます複雑な世界の予測不可能な挑戦により良く装備された技術システムを構築することができます。

私たちはいま、インテリジェンスにおける進化的転換点に立っています。この変化にできる限り多くの人々が、できるだけ多様な目的をもって関与することが不可欠です。参加と目的の多様性を欠いたまま進めば、ひとつのインテリジェンスのあり方が他のインテリジェンスを抑圧するような未来へと突き進む危険性があります。オープンエンデッドネスは、人間と人工知能の間のより協調的で多元的な関係への道を提供します。それは、異なる形のインテリジェンスを価値あるものにする違いを排除するのではなく、称賛する関係です。

Joseph Park is a researcher at DAL (joseph@dalab.xyz)

Illustration: Asuka Zoe Hayashi

Edits: Janine Liberty